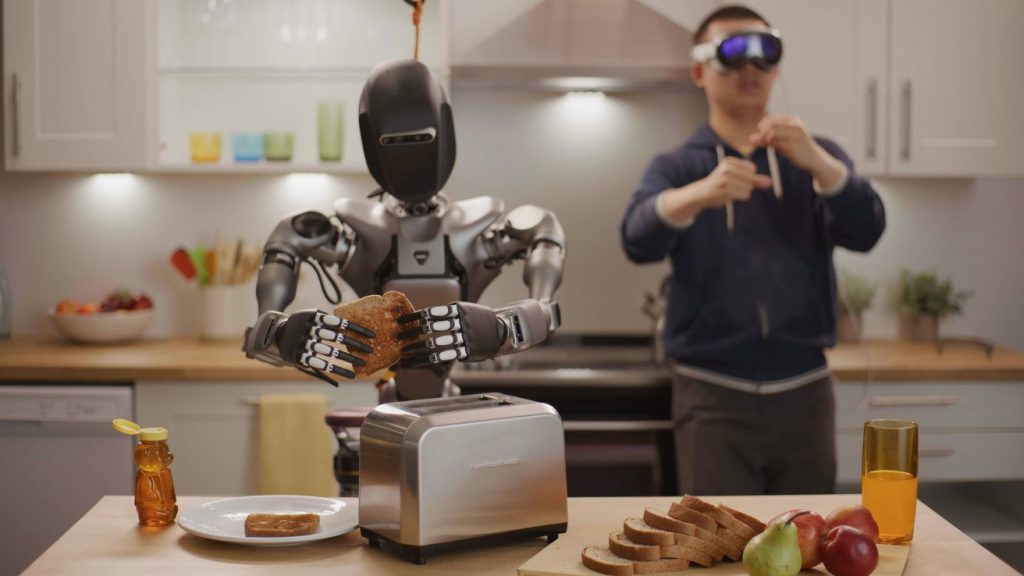

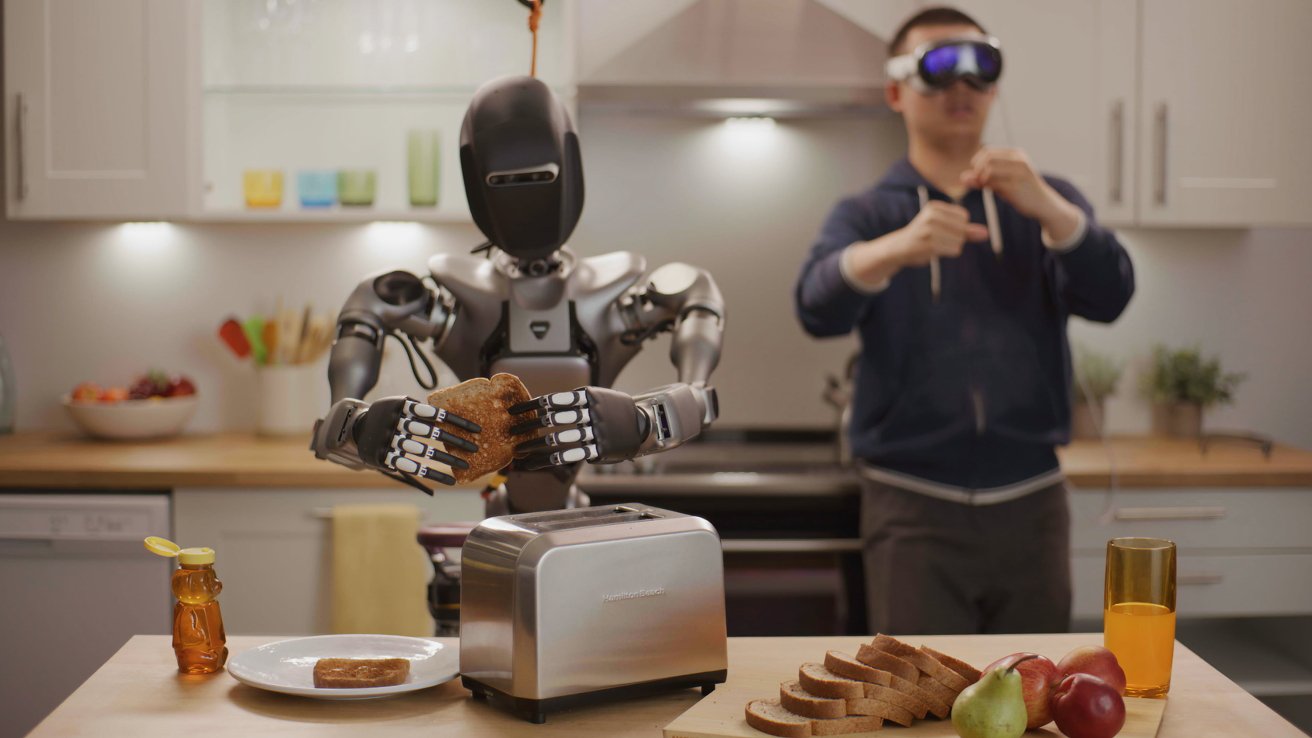

Robot ovládaný Apple Vision Pro (Nvidia)

Nová řídicí služba od Nvidie může vývojářům umožnit pracovat na projektech zahrnujících humanoidní robotiku, řízenou a monitorovanou pomocí Apple Vision Pro.

Vývoj humanoidních robotů má mnoho výzev, z nichž jednou je povaha ovládání vysoce technických zařízení. Na pomoc v této oblasti Nvidia zpřístupnila řadu nástrojů pro robotickou simulaci, včetně některých asistencí při ovládání.

Sada modelů a platforem, kterou Nvidia poskytuje hlavním výrobcům robotů a vývojářům softwaru, má pomoci trénovat novou generaci humanoidních robotů.

Sbírka nástrojů zahrnuje to, co Nvidia označuje jako mikroslužby a rámce NIM, určené pro simulaci a učení. K dispozici je také orchestrační služba Nvidia OSMO pro řešení vícestupňových úloh robotiky, stejně jako pracovní postupy teleoperace s umělou inteligencí a simulací.

V rámci těchto pracovních postupů lze náhlavní soupravy a prostorová výpočetní zařízení, jako je Apple Vision Pro, využít nejen k prohlížení dat, ale také k ovládání hardwaru.

„Další vlnou umělé inteligence je robotika a jedním z nejzajímavějších vývojů jsou humanoidní roboti,“ řekl generální ředitel a zakladatel Nvidie Jensen Huang. „Posouváme celý robotický balík NVIDIA a otevíráme přístup pro humanoidní vývojáře a společnosti z celého světa, aby mohli používat platformy, akcelerační knihovny a modely AI, které nejlépe vyhovují jejich potřebám.“

Ovládání Apple Vision Pro

Mikroslužby NIM jsou předpřipravené kontejnery, které využívají inferenční software Nvidia, který má zkrátit dobu nasazení. Dvě z těchto mikroslužeb jsou navrženy tak, aby pomáhaly vývojářům se simulačními pracovními postupy pro generativní fyzickou umělou inteligenci v rámci referenční aplikace Nvidia Isaac SIM.

Jedna, mikroslužba MimicGen NIM, se v podstatě používá k pomoci uživatelům ovládat hardware pomocí Apple Vision Pro nebo jiného prostorového výpočetního zařízení. Generuje syntetická data pohybu pro robota na základě „zaznamenaných teleoperovaných dat“, konkrétně převádí pohyby z Apple Vision Pro na pohyby, které má robot provádět.

Videa a obrázky ukazují, že jde o víc než jen pohyb kamery na základě pohybů náhlavní soupravy. Je ukázáno, že pohyby rukou a gesta jsou také zaznamenávány a používány na základě senzorů Apple Vision Pro.

Ve skutečnosti mohli uživatelé sledovat pohyby robota a přímo ovládat ruce a paže, to vše pomocí Apple Vision Pro.

I když by se takoví humanoidní roboti mohli snažit gesta přesně napodobit, systémy jako Nvidias by mohly odvodit, co chce uživatel místo toho dělat. Protože uživatelé nemají hmatovou zpětnou vazbu pro to, co robot drží, mohlo by být příliš nebezpečné přímo napodobovat pohyby rukou.

Další pracovní postup teleoperace demonstrovaný na Siggraph také umožnil vývojářům vytvářet velké množství dat o pohybu a vnímání. Vše vytvořeno z malého počtu na dálku zachycených ukázek člověka.

Pro tyto ukázky byl použit Apple Vision Pro k zachycení pohybů rukou člověka. Ty byly poté použity k simulaci nahrávek pomocí mikroslužby MimicGen NIM a Nvidia Isaac Sim, která generovala syntetické datové sady.

Vývojáři pak mohli trénovat humanoidní model Project Groot s kombinací skutečných a syntetických dat. Předpokládá se, že tento proces v první řadě pomůže snížit náklady a čas strávený vytvářením dat.

„Vývoj humanoidních robotů je extrémně složitý – vyžaduje neuvěřitelné množství reálných dat, únavně zachycených z reálného světa,“ říká Alex Gu, generální ředitel společnosti Fourier, výrobce robotické platformy. „Nové simulační a generativní vývojářské nástroje AI společnosti NVIDIA pomohou zavést a urychlit naše pracovní postupy vývoje modelů.“

Mikroslužby, stejně jako přístup k modelům, službě spravované robotiky OSMO a dalším rámcům, jsou všechny nabízeny v rámci programu Nvidia Humanoid Robot Developer Program. Společnost poskytuje přístup pouze výrobcům humanoidního softwaru, hardwaru nebo robotů.

Zdroj: appleinsider.com