Nová funkce zavedená jako součást beta verze iOS 18.2 umožňuje dětem v Austrálii hlásit nevhodný obsah přímo společnosti Apple.

Tato funkce je rozšířením bezpečnostních opatření společnosti Apple, která jsou součástí iOS 17. Tyto funkce automaticky detekují obrázky a videa, která obsahují nahotu z iMessage, AirDrop, FaceTime a Photos.

Zpočátku se při spuštění objeví dvojice intervenčních vyskakovacích oken. Ty by vysvětlovaly, jak kontaktovat úřady a instruovat dítě, aby upozornilo rodiče nebo opatrovníka.

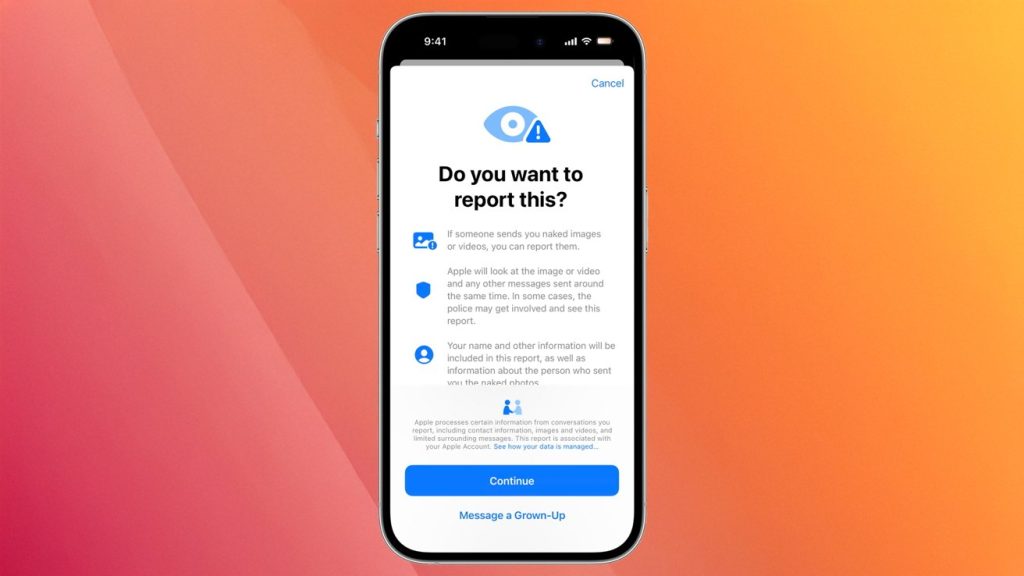

Nyní, když je detekována nahota, objeví se nové vyskakovací okno. Uživatelé budou moci nahlásit obrázky a videa přímo společnosti Apple, která by mohla informace zaslat úřadům.

Když se objeví varování, zařízení uživatele připraví zprávu obsahující jakýkoli urážlivý materiál, zprávy odeslané bezprostředně před nebo po materiálu a kontaktní informace pro oba účty. Uživatelé budou mít možnost vyplnit formulář s popisem toho, co se stalo.

Jakmile Apple zprávu obdrží, obsah bude zkontrolován. Odtud může společnost podniknout opatření týkající se účtu, včetně deaktivace možnosti uživatele odesílat zprávy přes iMessage a nahlášení problému orgánům činným v trestním řízení.

Tato funkce se v současné době zavádí jako součást beta verze iOS 18.2 v Austrálii, ale globálně bude uvedena později.

Jak The Guardian poukazuje na to, že Apple si pravděpodobně vybral Austrálii, protože tato země bude vyžadovat, aby společnosti do konce roku 2024 hlídaly zneužívání dětí a teroristický obsah ve službách zasílání zpráv v cloudu.

Apple varoval, že návrh kódu nebude chránit end-to-end šifrování, takže komunikace uživatelů bude zranitelná vůči hromadnému sledování. Apple je proti tomuto druhu úsilí od konce roku 2018.

Apple se dostal pod palbu kvůli tomu, jak na svých platformách nakládá s materiálem pro sexuální zneužívání dětí (CSAM). Zpočátku byla společnost obviňována, že nebrala ochranu CSAM vážně, což rozzlobilo mnoho hlídacích skupin.

V roce 2021 Apple plánoval zavést ochranu proti CSAM, která by skenovala uživatele iCloud Photos na známé obrázky CSAM. Pokud by byl obrázek nalezen, Apple by jej zkontroloval a poté by zprávu zaslala Národnímu centru pro pohřešované a zneužívané děti (NCMEC).

Mnoho uživatelů bylo pobouřeno představou, že by Apple skenoval jejich soukromé obrázky a videa, a obávali se falešných detekcí. Apple nakonec od této myšlenky upustil a uvedl, že se obával, že skenování dat „vytvoří nové vektory hrozeb, které by zloději dat našli a využili“.

V roce 2024 britská National Society for the Prevention of Cruelty to Children (NSPCC) uvedla, že na platformách Apple ve Spojeném království nalezla více případů zneužívání obrázků, než Apple globálně oznámil.

Zdroj: appleinsider.com