Fretka ve volné přírodě (Pixabay/Michael Sehlmeyer)

Apple Ferret LLM by mohl pomoci Siri porozumět rozvržení aplikací na displeji iPhonu a potenciálně tak zvýšit možnosti digitálního asistenta Apple.

Apple pracoval na mnoha projektech strojového učení a umělé inteligence, které by mohl otestovat na WWDC 2024. V právě vydaném článku se nyní zdá, že některé z těchto prací mají pro Siri potenciál pochopit, jak vypadají aplikace a samotný iOS.

Dokument, který v pondělí vydala Cornell University, se jmenuje „Fret-UI: Grounded Mobile UI Understanding with Multimodal LLMs“. V podstatě vysvětluje nový multimodální velký jazykový model (MLLM), který má potenciál porozumět uživatelským rozhraním mobilních displejů.

Název Ferret původně vzešel z open-source multimodálního LLM vydaného v říjnu výzkumníky z Cornell University ve spolupráci s protějšky z Applu. V té době byla Ferret schopna detekovat a porozumět různým oblastem obrazu pro složité dotazy, jako je identifikace druhu zvířete ve vybrané části fotografie.

Pokrok v LLM

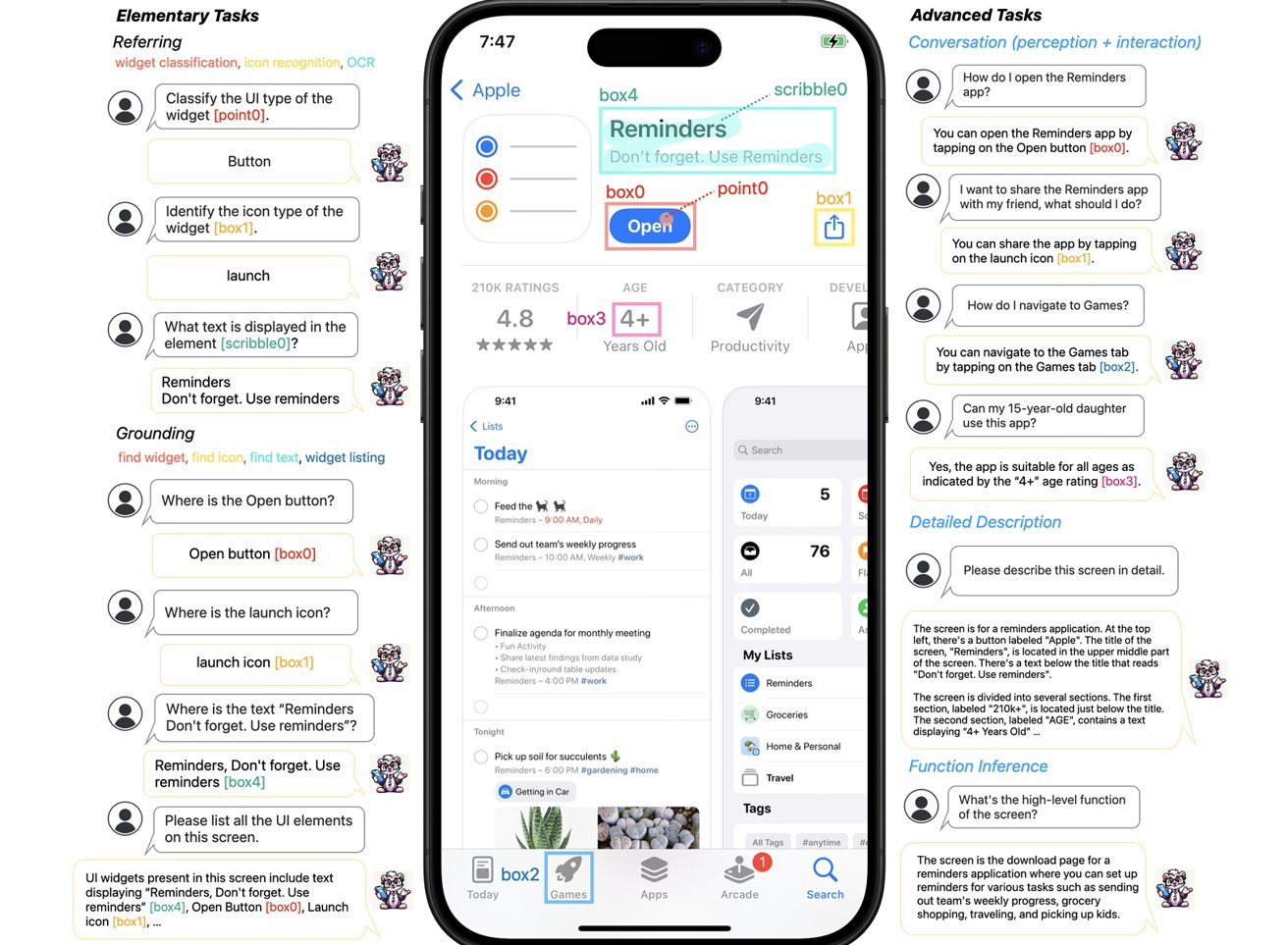

Nový dokument pro Ferret-UI vysvětluje, že i když došlo k pozoruhodnému pokroku v používání MLLM, stále „postrádají schopnost porozumět obrazovkám uživatelského rozhraní (UI) a efektivně s nimi interagovat.“ Ferret-UI je popisován jako nový MLLM šitý na míru pro pochopení mobilních obrazovek uživatelského rozhraní, doplněný o „možnosti odkazování, uzemnění a uvažování“.

Část problému, který mají LLM s pochopením rozhraní mobilního displeje, spočívá v tom, jak se používá. Často v orientaci na výšku to často znamená, že ikony a další detaily mohou zabírat velmi kompaktní část displeje, takže je pro stroje obtížné pochopit.

K tomu má Ferret k dispozici zvětšovací systém, který převzorkuje obrázky na „jakékoli rozlišení“, aby byly ikony a text čitelnější.

Příklad Ferret-UI analyzujícího displej iPhonu

Pro zpracování a školení Ferret také rozděluje obrazovku na dvě menší části a rozřezává obrazovku na polovinu. Dokument uvádí, že jiné LLM mají tendenci skenovat globální obrázek s nižším rozlišením, což snižuje schopnost adekvátně určit, jak ikony vypadají.

Přidáním významného zpracování dat pro školení je výsledkem model, který dokáže dostatečně porozumět uživatelským dotazům, porozumět povaze různých prvků na obrazovce a nabídnout kontextové odpovědi.

Uživatel by se například mohl zeptat, jak otevřít aplikaci Reminders, a dostat pokyn, aby klepl na tlačítko Otevřít na obrazovce. Další dotaz, zda by 15letý mohl používat aplikaci, by se mohl podívat na věkové pokyny, pokud jsou viditelné na displeji.

Pomocný asistent

I když nevíme, zda bude začleněno do systémů jako Siri, Ferret-UI nabízí možnost pokročilého ovládání zařízení, jako je iPhone. Tím, že rozumí prvkům uživatelského rozhraní, nabízí možnost Siri provádět akce pro uživatele v aplikacích, a to výběrem grafických prvků v rámci aplikace samostatně.

Nechybí ani užitečné aplikace pro zrakově postižené. Takový LLM by mohl být schopnější podrobně vysvětlit, co je na obrazovce, a potenciálně provádět akce za uživatele, aniž by musel dělat něco jiného, než aby o to žádal.

Zdroj: appleinsider.com