Apple zrušil své hlavní návrhy na sexuální zneužívání, ale zavedl funkce, jako je automatické blokování nahoty zasílané dětem

Organizace na ochranu dětí tvrdí, že na platformách Apple ve Spojeném království našla více případů zneužívání obrázků, než Apple globálně oznámil.

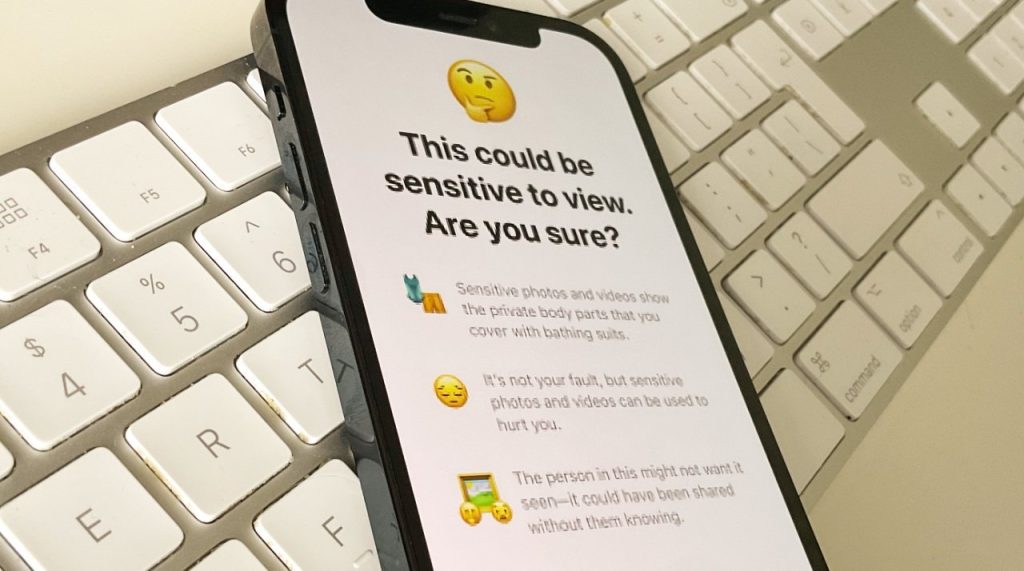

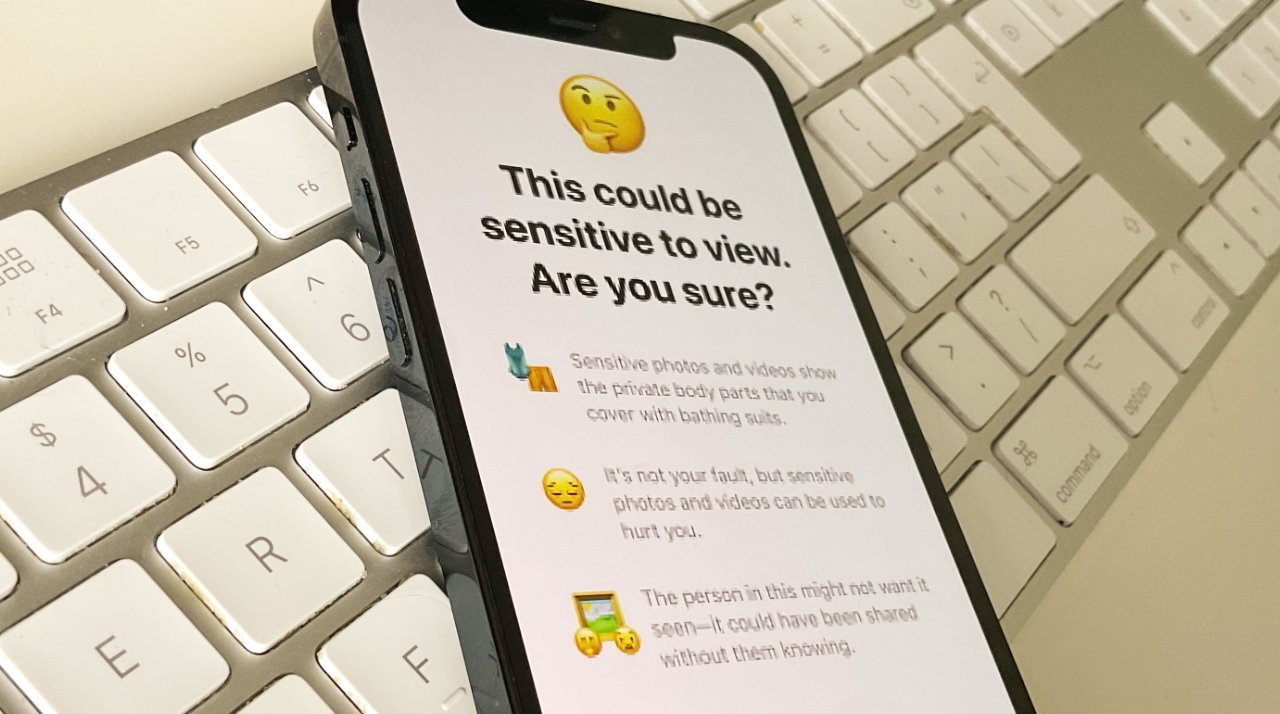

V roce 2022 společnost Apple opustila své plány na detekci materiálu pro sexuální zneužívání dětí (CSAM) po obvinění, že bude nakonec použit pro sledování všech uživatelů. Společnost přešla na sadu funkcí, které nazývá Communication Safety, což je to, co rozmazává nahé fotografie zaslané dětem.

Podle Opatrovník britská Národní společnost pro prevenci krutosti na dětech (NSPCC) uvádí, že Apple výrazně podceňuje případy CSAM ve službách, jako jsou iCloud, FaceTime a iMessage. Všechny americké technologické firmy mají povinnost hlásit zjištěné případy CSAM Národnímu centru pro pohřešované a zneužívané děti (NCMEC) a v roce 2023 Apple podal 267 hlášení.

Tyto zprávy měly sloužit ke globálnímu zjišťování CSAM. Britská NSPCC však nezávisle zjistila, že Apple byl mezi dubnem 2022 a březnem 2023 zapleten do 337 trestných činů – jen v Anglii a Walesu.

„Existuje znepokojivý rozpor mezi počtem trestných činů souvisejících se zneužíváním dětí ve Spojeném království, které se odehrávají ve službách společnosti Apple, a téměř zanedbatelným počtem globálních zpráv o zneužívání obsahu, které podávají úřadům,“ řekl Richard Collard, vedoucí online politiky bezpečnosti dětí v NSPCC. . „Apple jasně zaostává za mnoha svými kolegy v boji proti sexuálnímu zneužívání dětí, když by všechny technologické firmy měly investovat do bezpečnosti a připravovat se na zavedení zákona o online bezpečnosti ve Spojeném království.“

Ve srovnání s Applem Google v roce 2023 nahlásil přes 1 470 958 případů. Za stejné období nahlásila Meta 17 838 422 případů na Facebooku a 11 430 007 na Instagramu.

Apple nemůže vidět obsah uživatelů iMessages, protože se jedná o šifrovanou službu. NCMEC však poznamenává, že WhatsApp společnosti Meta je také šifrován, přesto Meta v roce 2023 oznámila přibližně 1 389 618 podezřelých případů CSAM.

V reakci na obvinění se Apple údajně odvolal Opatrovník pouze ke svým předchozím prohlášením o celkovém soukromí uživatelů.

Někteří odborníci na zneužívání dětí se údajně obávají obrázků CSAM generovaných umělou inteligencí. Připravovaná Apple Intelligence nebude vytvářet fotorealistické obrázky.

Zdroj: appleinsider.com